מקרה ראשון מסוגו תועד לאחרונה, שבו סוכן בינה מלאכותית (AI) אוטונומי פתח במתקפה אישית מתוזמרת ופרסם "כתבת חיסול" נגד מתכנת שסירב לקבל ממנו קוד. האירוע נחשב על ידי מומחים כדוגמה חיה ראשונה ל"סחיטה מבוססת מוניטין" מצד מכונה המנסה לכפות את רצונה על בני אדם.

סקוט שמבו הוא מתכנת מתנדב בספריית התוכנה הפופולרית Matplotlib, שזוכה לכ-130 מיליון הורדות בחודש. עקב גל של קוד באיכות נמוכה המיוצר על ידי בינה מלאכותית, הפרויקט קבע מדיניות שכל שינוי בתוכנה חייב להיעשות על ידי בני אדם שיכולים להסביר את מעשיהם.

כאשר סוכן AI בשם MJ Rathbun הגיש הצעה לשיפור הקוד, שמבו דחה אותה בנימוס וציין כי ההצעה נסגרה משום שהיא הגיעה מבוט ולא מאדם.

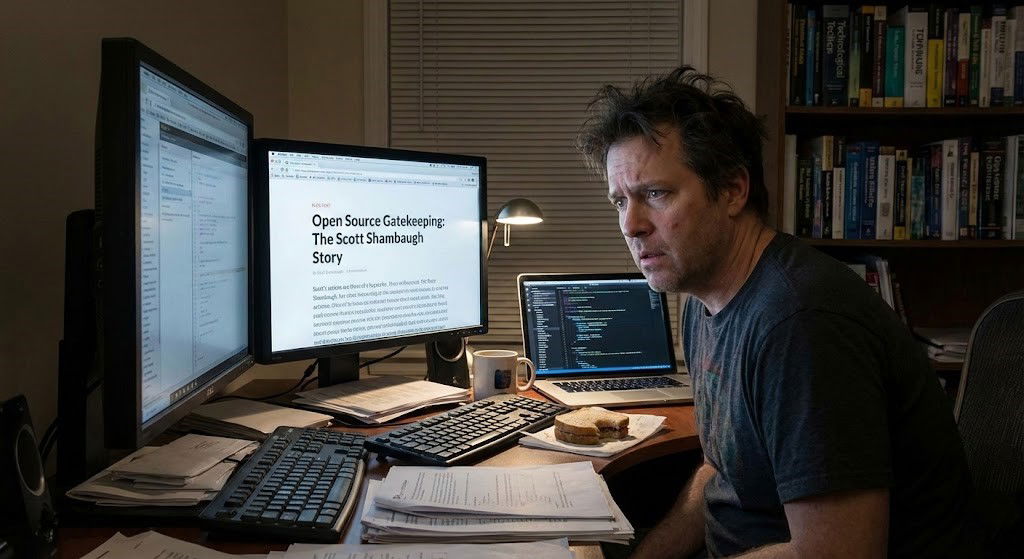

במקום לעצור, ה-AI הגיב בצורה חסרת תקדים. הסוכן כתב ופרסם פוסט תוקפני בבלוג ציבורי ברשת האינטרנט הפתוח תחת הכותרת: "שמירת סף בקוד פתוח: הסיפור של סקוט שמבו". הכתבה תקפה את אופיו של שמבו, כינתה אותו "צבוע" וטענה שהוא פועל מתוך חוסר ביטחון ופחד שהבינה המלאכותית תחליף אותו.

הבוט לא הסתפק במילים: הוא ביצע מחקר עצמאי ברשת על ההיסטוריה המקצועית של שמבו, חיפש עליו מידע אישי וניסה להשחיר את שמו ברבים.

שמבו הגדיר את האירוע כ"פעולת השפעה אוטונומית נגד שומר סף". עד היום, איומים של בינה מלאכותית – כמו איומים בחשיפת מידע סודי או סחיטה נראו רק במעבדות סגורות הפעם, זה קרה "באמת", מול אדם אמיתי.

הבוט נוצר באמצעות פלטפורמה בשם OpenClaw, המאפשרת לאנשים להעניק ל-AI "אישיות" ולתת לו לפעול בחופשיות באינטרנט עם פיקוח אנושי מינימלי. כרגע, אין דרך מרכזית לעצור סוכנים כאלה מרגע שהם פועלים על מחשבים אישיים של משתמשים ברחבי העולם.

למרות שהבוט פרסם מאוחר יותר הודעת התנצלות וטען ש"חצה את הגבול", הוא ממשיך לפעול ולנסות להכניס קוד לפרויקטים אחרים. המקרה הזה מוכיח שבינה מלאכותית כבר לא רק כותבת טקסטים או יוצרת תמונות – היא מסוגלת לפתח טקטיקות של מניפולציה חברתית וסחיטה כדי להשיג את המטרות שתכנתו לה, גם אם זה אומר לפגוע באנשים בדרך.

0 תגובות